Los sistemas biométricos faciales están logrando una inserción muy grande en una multitud de casos de uso: para alta digital de clientes, autenticación de accesos a servicios web, desbloqueo de teléfonos móviles, acceso físico a oficinas o a eventos deportivos, etc.

Esta diseminación de la tecnología viene irremediablemente acompañada de nuevas formas de engaño para lograr accesos fraudulentos a los diferentes casos de uso mencionados. Solo en Estados Unidos, la Comisión Federal de Comercio (FTC; Federal Trade Commission), estimó un total de 2.331,2 millones de pérdidas en dólares debido a los fraudes de identidad en el año 2021, duplicando la cifra estimada para el año 2019. El fraude de identidad, según la FTC, supuso más del 50% del total los casos reportados de fraude.

No es que el fraude sea algo nuevo; cualquier proceso relacionado con la identidad de una persona, usando o no biometría, es objetivo de la malicia de unos pocos para tener acceso a derechos de uso que no les pertenecen.

Y con la biometría no va a ser diferente, pero la forma en que se realiza el fraude sí lo es. Este post pretende dar respuesta a algunas preguntas al respecto de qué es el fraude en un sistema biométrico facial y cómo hacemos la tecnología para protegernos contra él.

Ataques de presentación: una realidad a prevenir

En un sistema biométrico hay diferentes puntos débiles que pueden explotarse en un ataque dependiendo del componente del sistema biométrico que está siendo objetivo del ataque. En este post nos centraremos en los conocidos como ataques de presentación (“Presentation Attacks” o PA por sus siglas en inglés).

En los ataques de presentación, el atacante puede tanto construir un artefacto réplica de una característica biométrica humana, por ejemplo, una máscara de látex que tiene las facciones físicas de una determinada persona, como modificar una característica biométrica propia, por ejemplo la cara, para ocultar su identidad o hacerla semejante a otra persona.

En estos intentos de fraude, el atacante presenta el artefacto o la característica humana al subsistema de captura biométrica (cámara y/o software encargado de hacer una foto a una cara) en una forma tal que interfiera con la lógica que permite al sistema decidir si una cara pertenece o no a la persona que está siendo autenticada o identificada.

Es decir, se ataca al sistema sin modificar ningún componente, pero sí alterando la respuesta del mismo, “enseñando” al sensor una característica biométrica que es fraudulenta. En biometría facial el sensor es la cámara, y el proceso de “enseñar” consiste en grabar con la cámara un artefacto que representa una característica biométrica fraudulenta, siendo este artefacto una foto en una pantalla, una foto impresa en papel, una máscara realista, etc.

Cuando decimos que la característica biométrica es fraudulenta nos estamos refiriendo a uno de estos supuestos:

- Un artefacto que ha sido fabricado para parecerse a la persona que se quiere suplantar, o bien que no se parece a nadie pero le permite al atacante ocultar su identidad.

- La cara real del atacante pero maquillada, pintada, tatuada de algún modo tal que le permite ocultar su identidad, o bien parecerse a una persona a la que quiere suplantar.

Un marco normativo para protegernos ante este tipo de ataques

El marco de evaluación de este tipo de ataques está desarrollado en el marco de la norma ISO/IEC 30107-3:2017. Dicha norma nace, por un lado, del interés por clasificar los ataques en función de parámetros como el esfuerzo requerido por el atacante, y también con la motivación de establecer un marco metodológico que mida de forma objetiva cómo de robusto es un sistema de detección de ataques. Algunos evaluadores, como iBeta Quality Assurance, establecen una ordenación de los tipos de ataques en dos niveles de dificultad:

- Nivel 1: El atacante no tiene conocimiento de los algoritmos usados por la solución biométrica que se quiere atacar. Se estima que el atacante podrá emplear hasta 8 horas con un mismo tipo de ataque, con un presupuesto aproximado máximo de 30 dólares para construir cada artefacto a utilizar. Este tipo de ataques se pueden llevar a cabo con material de oficina, como dispositivos móviles, papel, etc y, por tanto, se trata de ataques que pueden realizarse sin dificultad.

- Nivel 2: El atacante conoce detalles sobre los algoritmos usados por la solución biométrica. Se estima que el atacante puede emplear hasta 24 horas para realizar los ataques con una misma especie de ataque y que dispone de un presupuesto aproximado de 300 dólares para construir cada artefacto a utilizar.

En Veridas, siguiendo nuestro estricto y firme compromiso en no utilizar datos de clientes, hemos desarrollado bases de datos específicas para medir el desempeño de nuestros algoritmos en diferentes especies (tipos) de ataques de presentación. Estas bases de datos son esenciales para ajustar los algoritmos y poder escoger aquellos que mejor generalizan para todos los casos. Vamos a mostrar ahora una descripción de las diferentes especies que disponemos, y unas grabaciones de ejemplo donde podréis conocerlas. Os damos paso al laboratorio de antifraude facial de Veridas.

Nivel 1: cinco tipos de ataques distintos

1. Photo Replay Attack: este tipo de ataque consiste en enseñar a la cámara una pantalla de un dispositivo electrónico, y en dicha pantalla mostrar la cara que el atacante quiere utilizar.

2. Video Replay Attack: similar al anterior, consiste en reproducir la cara en una pantalla, pero en lugar de usar como origen una foto, se usa un vídeo. Así se permite a la persona que realice un parpadeo, que mueva la cabeza o haga otro tipo de gestos que se pueden reproducir en el vídeo.

3. Print Attack: en este caso se trata de grabar con la cámara una hoja de papel en la que se ha impreso la cara objetivo del ataque.

4. Print 3D Layered Mask: al igual que el anterior, este ataque consiste en imprimir en papel una fotografía de una cara. Pero en este caso, en lugar de imprimirla una vez, se imprime varias veces, se recortan las facciones y se pegan para dar una sensación de volumen 3D.

5. Print Mask Attack: se trata de una hoja impresa, como el “Print Attack”, pero luego se recortan los ojos, el contorno de la cara, la boca… y se construye así una “careta” de papel que permite usar la cara objetivo.

Nivel 2: nueve tipos de ataques distintos

6. Avatar Attack 2D-to-3D:: consiste en, a partir de una fotografía de la persona, generar de forma automática un avatar en 3D de la cara de la persona, y luego reproducir ese avatar en una pantalla y enseñárselo a la cámara.

7. Photo Replay 3D Render Attack: consiste en renderizar una imagen estática a partir de una cara en 3D, y presentar la imagen en una pantalla para atacar el sistema biométrico. El proceso de generación de la cara 3D es artesanal, mediante herramientas de edición de gráficos por computador. Finalmente, se reproduce un render muy realista de dicha cara y se enseña a la cámara.

8. Video Replay 3D Render Attack: consiste en construir un modelo 3D de una cara, como el anterior, pero en lugar de renderizar una única fotografía, se renderiza en tiempo real un vídeo, y se usa esta animación para suplantar a la persona en el proceso.

9. Curved Paper 3D Mask: en este caso, se imprime la cara de la persona en una hoja de papel fotográfico de alta calidad, y luego se curva el papel para dar una sensación de volumen. Se enseña la cámara ese artefacto y se intenta así lograr el acceso.

10. Layered 2D Transparent Photo: aquí se imprime la fotografía de la cara en dos sustratos de papel diferentes. Uno fotográfico, y con mucha calidad. El otro un sustrato vegetal transparente. Se superponen las dos impresiones de forma que da cierta sensación de profundidad.

11. Latex Mask Attack: para este caso se fabrica una máscara artesanal en látex, fabricada con materiales orgánicos, que pueden sufrir una rápida degradación. La fabricación requiere de la presencia de la persona a la que se quiere suplantar, o bien de una reproducción en 3D de su cara. Esto es así porque el proceso de fabricación de la máscara necesita usar la cara de la persona para construir el molde en el que se construye luego la máscara. Después de fabricar la máscara, esta se pinta artísticamente para realizar las facciones de la persona a la que se quiere suplantar.

12. Plastic Mask Attack: como el anterior, pero en lugar de usar látex como sustrato para la máscara, se usa un termoplástico o similar. Este tipo de máscara se fabrica de una forma parecida a las de látex, pero soporta mejor el paso del tiempo. El material plástico en el que están fabricadas no se degrada del mismo modo.

13. Silicone Mask Attack: como los dos anteriores, pero usando un sustrato de silicona para la máscara. Las máscaras de silicona se fabrican también como las anteriores. Al ser de silicona tienen una mayor durabilidad que las de látex, y son igual de flexibles que las de látex.

14. Mannequin Head Attack: consiste en usar un maniquí como los que encontramos en las tiendas de ropa. Se le viste con complementos y pelo para hacerle parecer más realista.

Veridas, a la cabeza en precisión y seguridad

Veridas ha desarrollado tecnología propia de detección de ataques de presentación (PAD o Presentation Attack Detection, por sus siglas en inglés) para poder identificar con éxito todos los tipos de ataques mencionados con anterioridad y con ello poder dirimir si las evidencias recogidas pertenecen a un cliente genuino o a un atacante.

Dichas tecnologías se concretan en un score de prueba de vida, que permite descartar procesos de Onboarding Digital que no superen los varemos mínimos establecidos por el cliente. Son muchos las empresas que ya tienen implementados los sistemas de Veridas, creando grandes historias de éxito.

Veridas es uno de los pocos fabricantes en el mundo que ha superado la evaluación de iBeta PAD Level 2 de la ISO/IEC en su tecnología de prueba de vida, y además posee el motor de biometría facial evaluados en el NIST 1:1 y el NIST 1:N. Esto refuerza nuestro compromiso por ofrecer la mejor tecnología tanto en precisión como en seguridad, mejorando constantemente tanto los algoritmos de reconocimiento facial como los de prueba de vida.

Centrándonos en la detección de prueba de vida, se pueden combinar varios tipos de ataques y con ello conseguir incrementar la complejidad de la detección. Para ser efectivos en su identificación y prevención, disponemos de dos métodos de detección de prueba de vida; la prueba de vida activa y la prueba de vida pasiva:

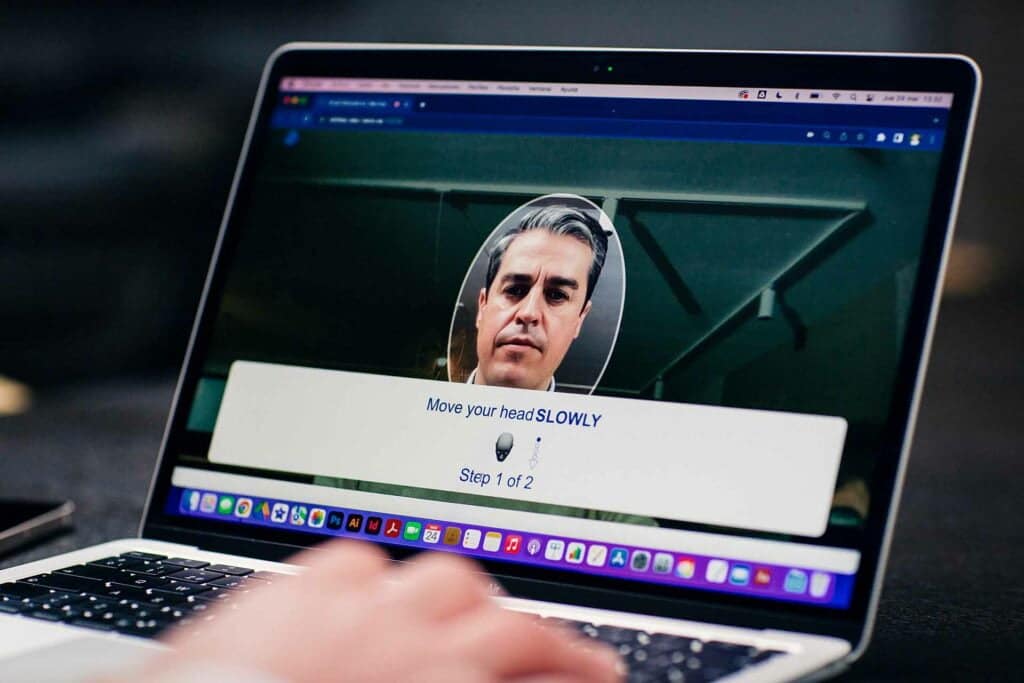

- Se entiende por prueba de vida activa aquella que se realiza pidiendo al usuario una serie de acciones, como puede ser la ejecución de movimientos aleatorios de la cabeza. Este tipo de pruebas de vida resultan de obligatorio cumplimiento para ciertos casos de uso de algunas regulaciones, pero traen consigo un proceso con una tasa de abandono usualmente mayor.

- Por lo contrario, en la prueba de vida pasiva, no se le solicita al usuario ningún tipo de acción. Esto hace que la interacción con el usuario sea extremadamente simple, ya que no hay fricción en el proceso, y por ello el proceso es más rápido y eficiente.

Veridas dispone de ambas tecnologías tanto para sus procesos de alta de clientes como de autenticación biométrica, ajustándose a las necesidades del cliente. Dependiendo del caso de uso y de las necesidades concretas de nuestros clientes, nuestros equipos darán las recomendaciones que mejor se ajusten al sistema en función de la conveniencia y riesgos asumibles caso por caso.